Comment l’IA transforme la détection LCB-FT : de l’exhaustivité à la pertinence opérationnelle

12/05/2026

LCB-FT & Intelligence Artificielle

Comment l’IA transforme la détection LCB-FT : de l’exhaustivité à la pertinence opérationnelle

Aujourd’hui, les retours d’expérience terrain montrent que la grande majorité des alertes générées (souvent estimée entre 85 et 95 %) ne correspond à aucun risque avéré. Par fausse alerte, on entend une alerte générée par les outils de détection qui, après analyse, ne conduit à l’identification d’aucun risque avéré. Ce chiffre, observé de manière convergente dans les dispositifs que nous accompagnons, ne traduit pas une surperformance des outils de détection. Il révèle au contraire une faiblesse structurelle que l’ensemble du secteur reconnaît – souvent sans l’adresser.

Pendant des années, la robustesse d’un dispositif LCB-FT s’est mesurée à sa capacité à couvrir largement, à détecter massivement, à ne rien laisser passer. Cette logique d’exhaustivité a satisfait les régulateurs dans un contexte où l’absence de contrôle était le risque principal. Elle a aussi, progressivement, saturé les organisations qui en avaient la charge.

Aujourd’hui, un dispositif qui produit trop d’alertes n’est plus un dispositif protecteur. C’est un dispositif qui perd en lisibilité, en efficacité et, à terme, en maîtrise réelle. La surproduction d’alertes n’est pas un excès de zèle. C’est un signal de dysfonctionnement qui peut venir polluer le traitement des alertes réellement fondée.

Dans certains établissements accompagnés par notre équipe NOVERISK, plusieurs milliers d’alertes sont traitées quotidiennement pour une proportion marginale de cas réellement sensibles. Les conséquences sont documentées et convergentes :

- Des équipes mobilisées majoritairement sur des dossiers à faible enjeu

- Une dilution des signaux critiques dans des volumes devenus difficilement exploitables

- Des délais incompatibles avec certains profils à risque élevé

- Une perte progressive de sens et d’engagement chez les analystes

| 85–95% Des alertes sans risque avéré Constat convergent — missions Noverisk |

> 90% De faux positifs sur le filtrage sanctions Observé en mission client |

I. De la détection massive à la détection pertinente

L’enjeu n’est plus de détecter davantage. Il est de réduire l’écart entre signal généré et risque réel. Derrière cette formulation apparemment simple se cache un changement de paradigme profond dans la conception même des dispositifs.

L’intelligence artificielle ne constitue pas une rupture technologique en soi. Elle marque une rupture méthodologique : celle du passage d’une logique de règles statiques à une logique d’analyse dynamique du risque. Son rôle n’est pas de décider – c’est celui des équipes et du dispositif de gouvernance. Son rôle est de requalifier, contextualiser et prioriser.

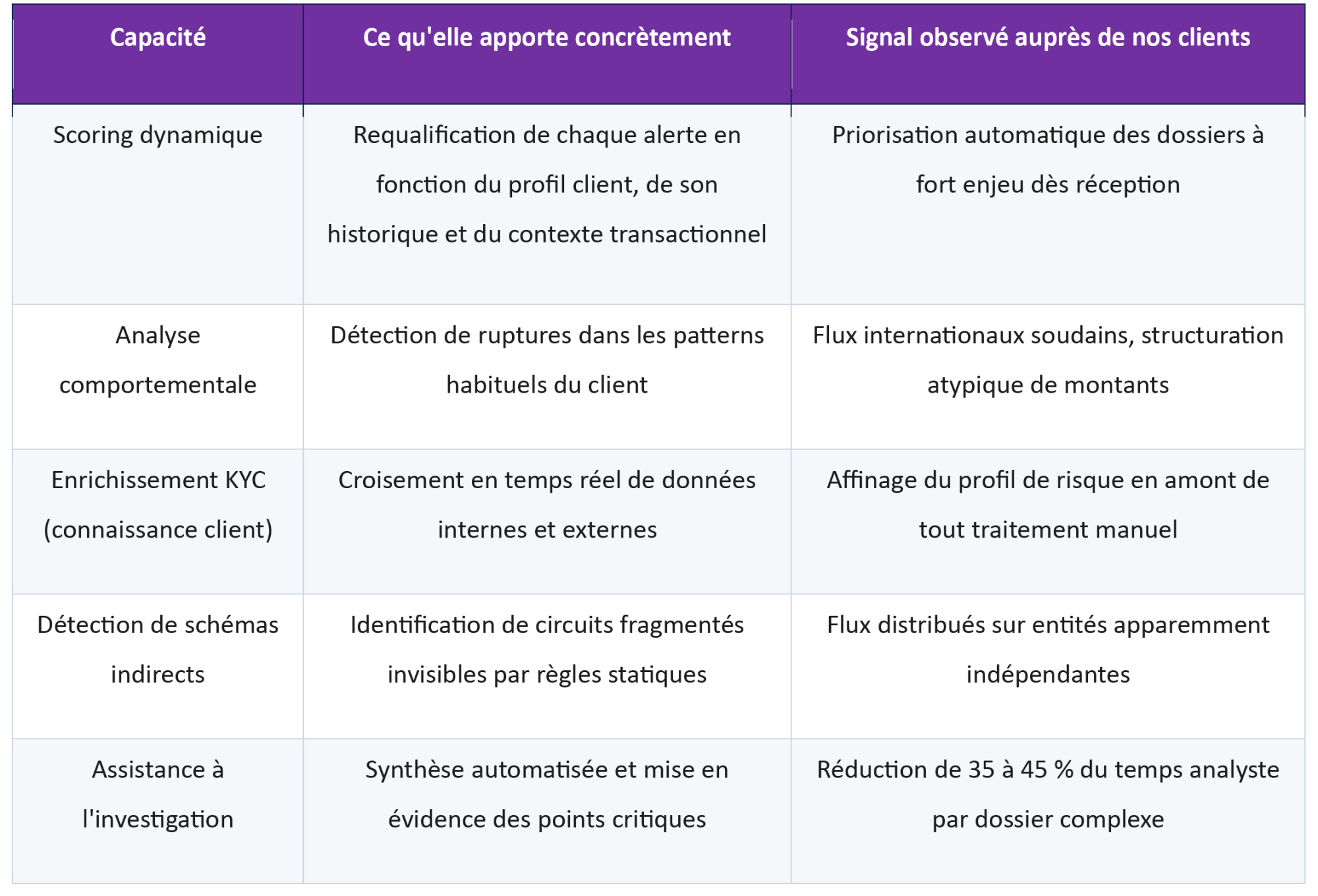

Les briques fonctionnelles des dispositifs matures :

Dans les déploiements les plus matures que nous accompagnons, ces approches permettent de réduire de 30 à 50 % le volume d’alertes à faible valeur, tout en améliorant la détection des cas complexes. Mais leur apport principal est ailleurs : elles redonnent de la lisibilité et de la hiérarchie au risque.

| −40% De volume d’alertes « faible valeur » avec l’IA Dispositifs matures accompagnés |

× 2–3 De gain de productivité analyste Référence marché & terrain |

Dans les dispositifs les plus matures, l’intégration de briques d’intelligence artificielle permet de réduire de l’ordre de 30 à 50 % le volume d’alertes à faible valeur, tout en améliorant la détection des cas complexes.

II. Trois cas d’usage au cœur des enjeux terrain

2.1 Filtrage des sanctions : optimiser le traitement des alertes dans un cadre de conformité maîtrisé

C’est l’un des sujets qui revient le plus systématiquement dans nos missions. L’objectif n’est pas de réduire le niveau de vigilance ni de limiter le périmètre de détection, mais d’évoluer vers un filtrage plus ciblé, à couverture réglementaire constante. Les approches basées sur l’intelligence artificielle permettent de diminuer significativement les faux positifs en requalifiant le signal à partir d’analyses contextuelles, tout en maintenant une capacité de détection conforme aux exigences réglementaires.

Retour d’expérience

Lors d’une mission conduite auprès d’une compagnie d’assurance, nous avons observé que la grande majorité des alertes issues du filtrage sanctions correspondait à des faux positifs évidents, principalement liés à des homonymies. L’introduction d’un scoring sémantique contextuel intégrant la géographie, l’activité déclarée et l’historique transactionnel a permis de réduire le volume traité manuellement de 65 %, sans aucune dégradation de la couverture réglementaire.

L’apport de l’IA réside ici dans sa capacité à introduire une lecture contextuelle du signal : analyse sémantique des correspondances, scoring de similarité multicritères, intégration du contexte client. L’objectif n’est pas de réduire le niveau de vigilance, c’est de concentrer l’attention là où elle est réellement nécessaire.

2.2 Personnes Politiquement Exposées PPE : d’une classification statique à une vision dynamique

C’est un autre point de friction récurrent dans nos diagnostics. La gestion des PPE reste, dans de nombreux dispositifs, fondée sur une approche figée : on classe, on surveille, on documente – mais on détecte mal le changement. Or le risque PPE est par nature évolutif.

Deux clients classés PPE peuvent présenter des profils radicalement différents selon leur trajectoire récente : l’un stable, avec une activité cohérente ; l’autre en rupture, avec des flux atypiques ou des expositions nouvelles. Les approches avancées intègrent désormais la temporalité du risque, les comportements transactionnels et les évolutions de l’environnement relationnel.

Retour d’expérience

Sur un chantier conduit avec un établissement de premier rang, cette approche dynamique a permis d’identifier des signaux PPE réels que le dispositif précédent ne captait pas précisément parce qu’ils ne correspondaient à aucun critère statique de la liste de surveillance. Le risque existait – il n’était simplement pas visible dans le dispositif.

2.3 Qualité de la donnée : le prérequis que l’IA ne contourne pas

C’est l’enseignement le plus constant de nos interventions terrain. Aucun modèle ne peut corriger une donnée dégradée. Dans les organisations où les référentiels clients sont fragmentés, les données KYC hétérogènes et les sources non alignées, l’IA n’améliore pas le dispositif – elle en amplifie les incohérences.

Les projets les plus efficaces que nous accompagnons sont donc, avant tout, des projets de gouvernance et de structuration de la donnée. Ce prérequis souvent sous-estimé dans les feuilles de route IA conditionne l’ensemble des performances en aval. La qualité du signal de risque dépend directement de la qualité des données qui l’alimentent.

III. Gouvernance, explicabilité et pilotage des modèles

3.1 L’exigence d’explicabilité n’est pas négociable

Dans le cadre des attentes de l’ACPR et de l’AMF, la performance ne peut être dissociée de la maîtrise. Un modèle performant mais non explicable est, de fait, inexploitable en environnement LCB-FT. Cette exigence s’étend également aux dispositifs de filtrage, dont les paramétrages et les évolutions doivent pouvoir être justifiés auprès du régulateur, ce n’est pas une contrainte accessoire : c’est une condition d’existence.

Les dispositifs doivent permettre de justifier chaque décision, de tracer les raisonnements sous-jacents, de contrôler les biais et d’assurer un audit complet des modèles. L’IA en conformité n’est pas une boîte noire. C’est un système sous contrôle ou ce n’est pas un système utilisable. La réglementation « IA Act » renforce clairement ces attentes.

3.2 L’émergence d’une nouvelle fonction : le pilotage des modèles

L’intégration de l’IA transforme profondément le rôle des fonctions conformité. On observe l’émergence progressive d’une capacité nouvelle : le pilotage des modèles de détection qui implique un suivi continu des performances, l’identification proactive des dérives (data drift, model drift), une documentation systématique des évolutions et une articulation étroite avec le contrôle interne.

Cette évolution marque un basculement stratégique que nous observons chez nos clients les plus avancés : la conformité va au-delà de la seule application de règles. Elle pilote des systèmes d’analyse du risque règlementaire.

3.3 Le reporting réglementaire comme outil de pilotage stratégique

L’automatisation transforme également le reporting : données plus fiables et homogènes, réduction des retraitements manuels, cohérence accrue des indicateurs, capacité accrue à piloter le risque à un niveau stratégique. Le reporting cesse d’être une contrainte opérationnelle. Il devient un instrument de décision.

Ce qui change réellement

La transformation en cours n’est pas d’abord technologique. Elle est avant tout conceptuelle. Elle repose sur un changement de paradigme que résument trois mouvements :`

- De la couverture à la pertinence : détecter mieux, pas davantage

- Du volume à la hiérarchisation : prioriser le signal, pas le multiplier

- De la détection à l’analyse : comprendre le risque, pas seulement l’identifier

L’exhaustivité, en tant que principe de couverture des risques, reste au fondement des dispositifs LCB-FT. Toutefois, lorsqu’elle se traduit par une production non hiérarchisée de signaux, elle peut générer des inefficacités opérationnelles et nuire à la lisibilité du risque.

L’intelligence artificielle constitue un levier puissant de cette transformation. Mais elle n’est performante que lorsqu’elle s’inscrit dans un cadre maîtrisé : gouvernance de la donnée, pilotage des modèles, expertise métier. C’est à cette condition que les organisations passeront d’une illusion de contrôle à une maîtrise effective du risque.

Le modèle Noverisk repose sur 3 piliers opérationnels : qualité de la donnée, gouvernance des modèles et expertise opérationnelle. C’est sur cette base que nous intervenons avec la conviction que la performance ne vient pas de la quantité d’alertes traitées, mais de la pertinence du risque effectivement maîtrisé.

Vous reconnaissez ces enjeux dans votre organisation ?

Nous intervenons auprès des directions conformité pour transformer des dispositifs saturés en systèmes réellement pilotés par le risque sur l’ensemble de la chaîne de valeur : du diagnostic de maturité à la mise en œuvre opérationnelle, en passant par la gouvernance de la donnée et le pilotage des modèles IA.

Nous proposons notamment :

- Audit flash de votre dispositif LCB-FT existant

- Diagnostic de maturité IA & conformité

- Atelier de cadrage ou benchmark sectoriel

- Échange exploratoire avec notre équipe senior